Regularización en CNN: optimiza tus resultados de aprendizaje profundo

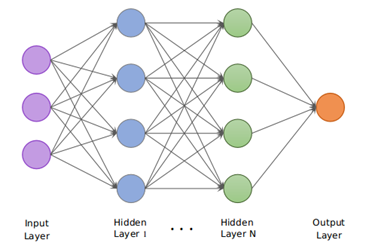

El aprendizaje profundo es una rama de la inteligencia artificial que ha revolucionado la forma en que se procesan datos y se toman decisiones. Una de las técnicas más utilizadas en el aprendizaje profundo son las redes neuronales convolucionales (CNN), que han demostrado ser muy efectivas en la clasificación de imágenes y en el procesamiento de señales.

Sin embargo, el aprendizaje profundo también presenta algunos desafíos, como el sobreajuste (overfitting) y el bajo rendimiento en datos de prueba. Afortunadamente, existe una técnica llamada regularización que puede ayudar a optimizar los resultados de los modelos de CNN.

En este artículo, exploraremos qué es la regularización y cómo se puede aplicar en las redes neuronales convolucionales para mejorar su rendimiento.

¿Qué es la regularización?

La regularización es una técnica que se utiliza para evitar el sobreajuste en los modelos de aprendizaje profundo. El sobreajuste ocurre cuando un modelo se ajusta demasiado a los datos de entrenamiento y pierde su capacidad para generalizar en nuevos datos. En otras palabras, el modelo se vuelve demasiado complejo y se ajusta demasiado a los datos de entrenamiento, perdiendo su capacidad para generalizar en nuevos datos.

La regularización implica agregar una penalización a la función de costo del modelo para reducir su complejidad. Esta penalización puede tomar diferentes formas, pero la más común es la penalización L1 o L2.

Penalización L1 y L2

La penalización L1 y L2 son dos formas comunes de regularización en las redes neuronales convolucionales.

La penalización L1 agrega una penalización proporcional al valor absoluto de los coeficientes del modelo. En otras palabras, la penalización L1 fuerza al modelo a reducir el número de características relevantes, eliminando las características irrelevantes.

La penalización L2 agrega una penalización proporcional al cuadrado de los coeficientes del modelo. La penalización L2 fuerza al modelo a reducir el tamaño de los coeficientes, reduciendo la influencia de las características irrelevantes.

En general, la penalización L2 es más efectiva que la penalización L1 en la regularización de las redes neuronales convolucionales.

Dropout

Otra técnica común de regularización en las redes neuronales convolucionales es el dropout. El dropout es una técnica que se utiliza para reducir el sobreajuste en los modelos de aprendizaje profundo.

El dropout implica eliminar aleatoriamente algunas de las neuronas de la red durante el entrenamiento. Esto permite que la red aprenda a ser más robusta y a generalizar mejor en nuevos datos. Durante la inferencia, todas las neuronas están activas y la red funciona normalmente.

Batch Normalization

Batch Normalization es otra técnica de regularización que se utiliza en las redes neuronales convolucionales. Batch Normalization normaliza los valores de activación de cada capa en la red, lo que ayuda a reducir el impacto de las diferentes escalas de los datos de entrada.

Batch Normalization también ayuda a reducir el tiempo de entrenamiento de la red, ya que reduce la dependencia de la inicialización de los pesos y los sesgos.

Conclusión

La regularización es una técnica importante en el aprendizaje profundo que ayuda a evitar el sobreajuste y optimizar los resultados de los modelos de CNN. Las técnicas de regularización más comunes son la penalización L1 y L2, el dropout y la Batch Normalization.

Cada técnica de regularización tiene sus propias ventajas y desventajas, por lo que es importante experimentar con diferentes métodos para encontrar el que mejor funcione para su conjunto de datos y modelo. Al aplicar la regularización de manera efectiva, puede mejorar significativamente el rendimiento de su modelo de CNN.

Preguntas frecuentes

1. ¿Qué es el sobreajuste en las redes neuronales convolucionales?

El sobreajuste ocurre cuando un modelo se ajusta demasiado a los datos de entrenamiento y pierde su capacidad para generalizar en nuevos datos. En otras palabras, el modelo se vuelve demasiado complejo y se ajusta demasiado a los datos de entrenamiento, perdiendo su capacidad para generalizar en nuevos datos.

2. ¿Qué es la penalización L1?

La penalización L1 agrega una penalización proporcional al valor absoluto de los coeficientes del modelo. En otras palabras, la penalización L1 fuerza al modelo a reducir el número de características relevantes, eliminando las características irrelevantes.

3. ¿Qué es la penalización L2?

La penalización L2 agrega una penalización proporcional al cuadrado de los coeficientes del modelo. La penalización L2 fuerza al modelo a reducir el tamaño de los coeficientes, reduciendo la influencia de las características irrelevantes.

4. ¿Qué es el dropout?

El dropout es una técnica que se utiliza para reducir el sobreajuste en los modelos de aprendizaje profundo. El dropout implica eliminar aleatoriamente algunas de las neuronas de la red durante el entrenamiento.

5. ¿Qué es la Batch Normalization?

Batch Normalization es otra técnica de regularización que se utiliza en las redes neuronales convolucionales. Batch Normalization normaliza los valores de activación de cada capa en la red, lo que ayuda a reducir el impacto de las diferentes escalas de los datos de entrada.

Deja una respuesta